Trong bối cảnh các bộ xử lý đồ họa (GPU) mới liên tục được tối ưu hóa cho các tác vụ trí tuệ nhân tạo (AI), một thử nghiệm gần đây đã cho thấy điều bất ngờ khi một GPU cũ như NVIDIA V100, ra mắt cách đây 8 năm, lại có thể vượt trội hơn một số sản phẩm mới hơn trong việc xử lý các mô hình ngôn ngữ lớn (LLM).

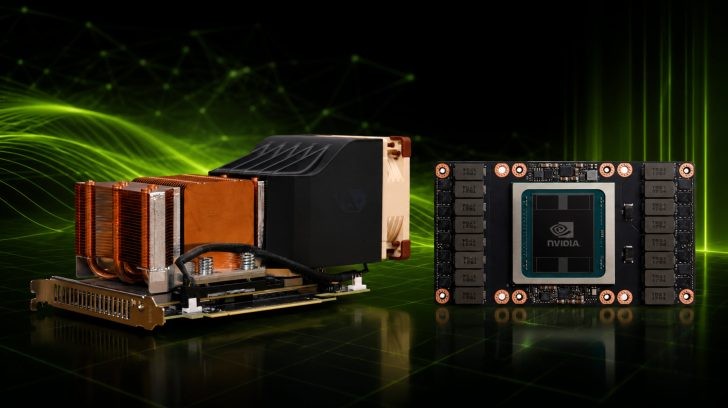

NVIDIA V100 thuộc thế hệ Volta, dòng GPU đầu tiên được thiết kế chuyên biệt cho trung tâm dữ liệu và không dành cho phân khúc game thủ thông thường. Đây cũng là dòng sản phẩm đầu tiên tích hợp kiến trúc Tensor Core, nền tảng quan trọng cho những tiến bộ về AI của NVIDIA. Mặc dù kiến trúc Tensor Core đã phát triển đáng kể kể từ thời Volta, kênh YouTube Hardware Haven đã quyết định thử nghiệm một GPU V100 8 năm tuổi để xem khả năng của nó trong các LLM hiện đại.

GPU NVIDIA Tesla V100 có hai dạng: bo mạch SXM và phiên bản PCIe. Các mẫu SXM chủ yếu được sử dụng trong trung tâm dữ liệu, kết nối qua một đầu nối mezzanine cho phép cấp nguồn trực tiếp và định tuyến NVLink. Phiên bản V100 được thử nghiệm là mẫu SXM2, có 5120 nhân CUDA, 320 TMU, 128 ROP và 640 Tensor Core. Thiết bị này sở hữu 6 MB bộ nhớ đệm L2, tốc độ xung nhịp lên tới 1530 MHz và 16 GB hoặc 32 GB bộ nhớ HBM2 trên giao diện bus 4096-bit, đạt băng thông 898 GB/s. Mức tiêu thụ điện năng (TDP) của GPU là 250W, khá thấp so với các mẫu Blackwell hiện tại có thể lên tới hơn 1KW.

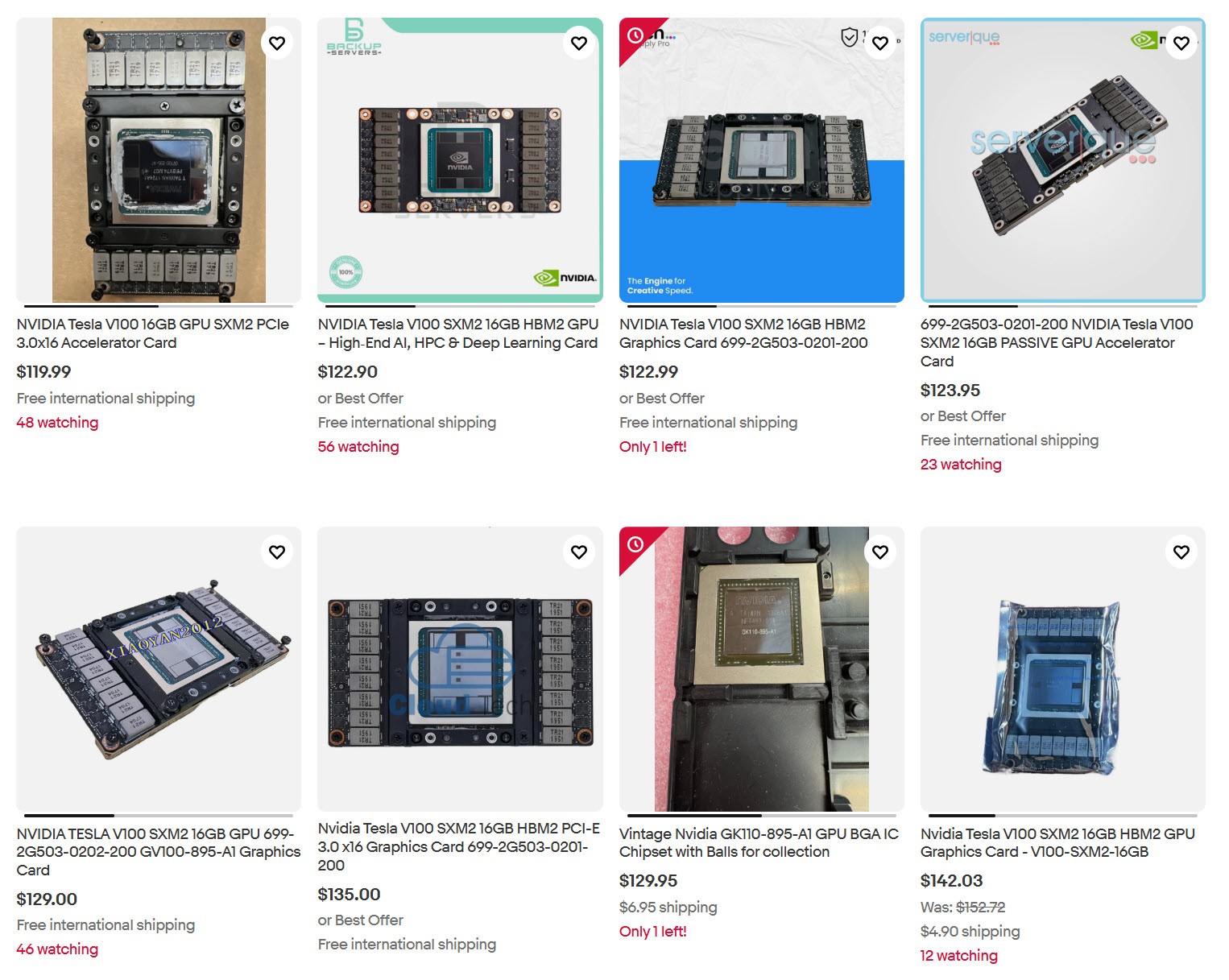

Khi mới ra mắt, NVIDIA Tesla V100 có giá hơn 10.000 USD (khoảng 262 triệu đồng), nhưng hiện tại, phiên bản 16 GB có thể mua trên eBay với giá chỉ khoảng 100 USD (khoảng 2,6 triệu đồng).

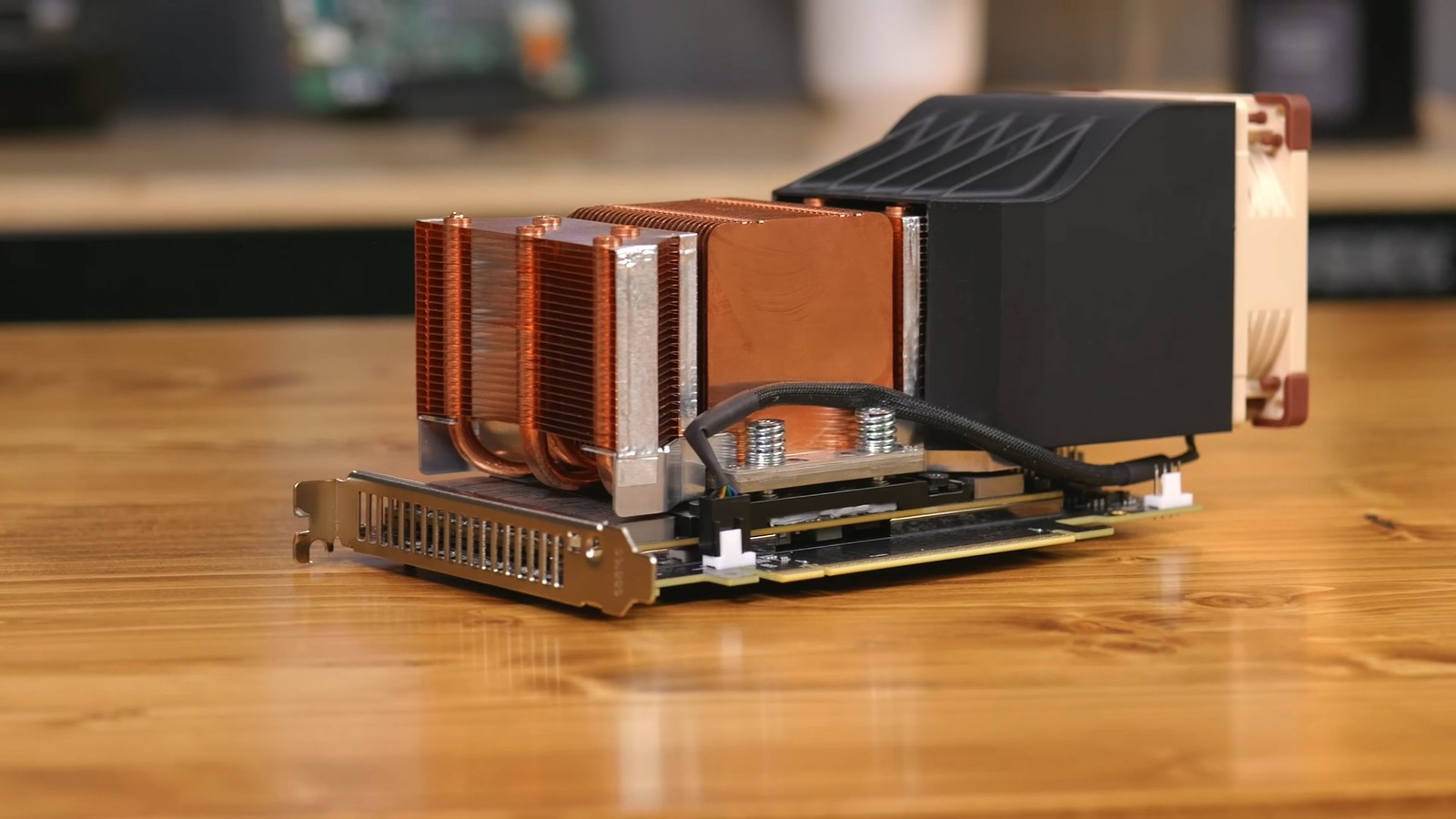

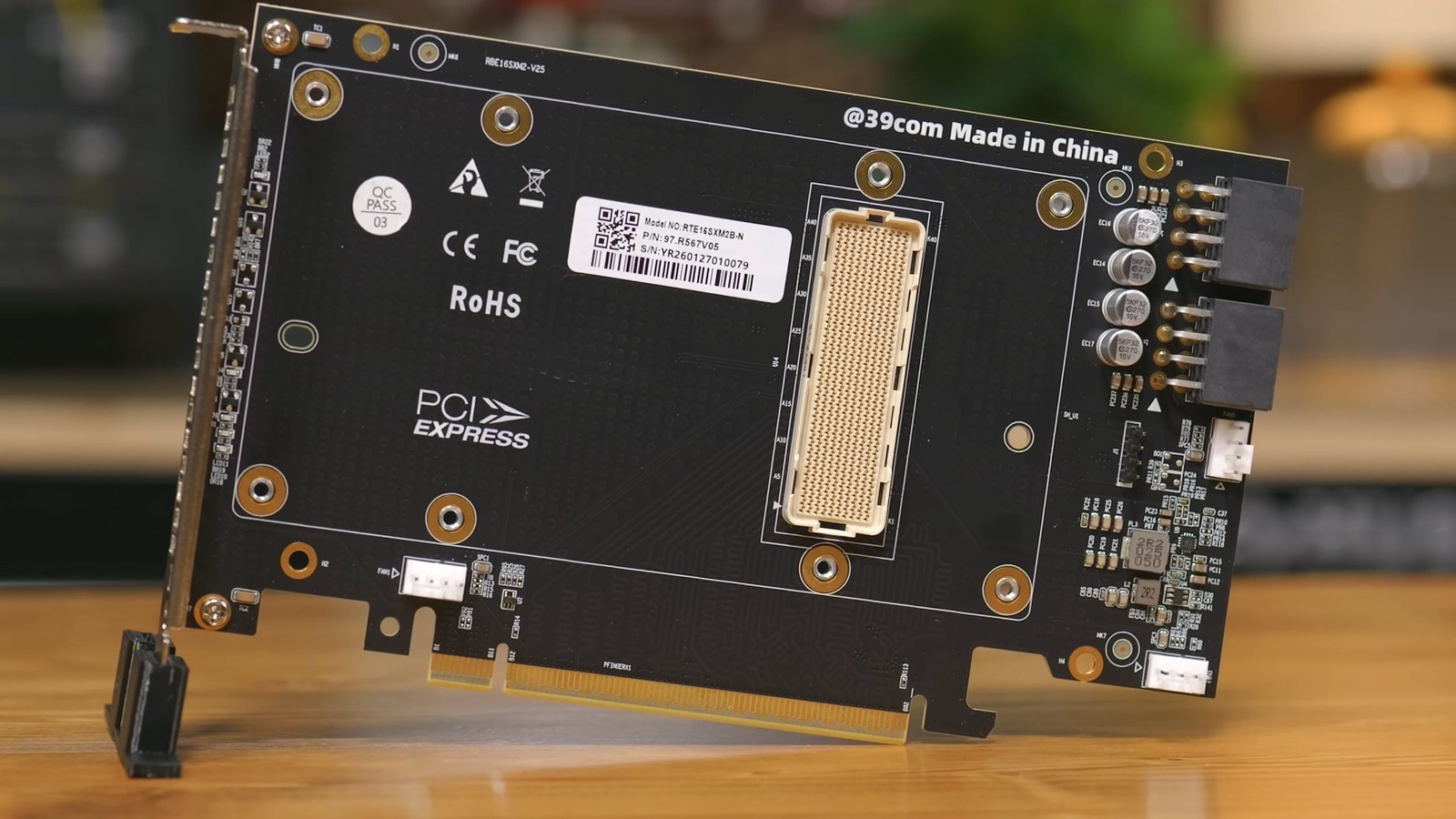

Vấn đề chính không nằm ở giá của GPU mà là khả năng tương thích với máy tính cá nhân thông thường, vì không có máy tính nào hỗ trợ chuẩn SXM2. Điều này đòi hỏi phải có một bộ chuyển đổi từ SXM sang PCIe, đi kèm với cấu hình hai đầu nối 8-pin riêng và ba đầu cắm quạt 4-pin. Một trở ngại khác là giải pháp tản nhiệt. Dòng NVIDIA Tesla được thiết kế cho trung tâm dữ liệu quy mô lớn và hoạt động thụ động với một bộ tản nhiệt lớn. Mặc dù bộ tản nhiệt và tấm nền trên GPU có chất lượng cao, chúng không thể duy trì hoạt động 24/7 trong các máy tính cá nhân tiêu chuẩn. Do đó, người thực hiện thử nghiệm đã phải tự chế tạo một ống dẫn khí làm mát bằng công nghệ in 3D và sử dụng một quạt Noctua để cung cấp luồng khí trực tiếp vào bộ tản nhiệt.

Tổng chi phí cho GPU và các phụ kiện bổ sung là hơn 200 USD (khoảng 5,2 triệu đồng), vẫn thấp hơn so với các mẫu được dùng để so sánh như RTX 3060 12 GB và RX 7800 XT 16 GB. Trong thử nghiệm LLM đầu tiên với GPT-oss 20 tỷ tham số, hệ thống NVIDIA V100 có thể tạo ra khoảng 130 token/giây, trong khi RX 7800 XT chỉ đạt khoảng 90 token/giây.

So với NVIDIA GeForce RTX 3060 12 GB (khoảng 5 năm tuổi), NVIDIA V100 nhanh hơn 42% trong Gemma4:e4b (ollama+openwebui) về tốc độ tạo token. Điều ấn tượng hơn là hiệu quả năng lượng của GPU 8 năm tuổi này, mặc dù có mức tiêu thụ điện năng cao hơn, nhưng vẫn vượt trội hơn 12% so với GPU dựa trên kiến trúc Ampere mới hơn. Khi được thử nghiệm với giới hạn công suất 100W, V100 một lần nữa vượt trội hơn RTX 3060 với hiệu quả năng lượng cao hơn 41% trong các bài kiểm tra token/giây/watt.

Kết quả chứng minh rằng các GPU cũ vẫn có thể khả dụng cho các LLM AI, mang lại giá trị và hiệu quả tốt. Tuy nhiên, chúng đòi hỏi phải có những điều chỉnh bổ sung mà không phải ai cũng có thể thực hiện. Phiên bản 32 GB có giá khoảng 400 - 500 USD (khoảng 10,5 - 13 triệu đồng), nhưng dung lượng bộ nhớ lớn hơn có thể hỗ trợ tốt hơn cho các LLM AI lớn hơn. Kênh công nghệ này dự định thực hiện thêm các thử nghiệm trong tương lai.

Max